AquaSmart RAS — 대서양연어 사료 자동공급 알고리즘

01 Headline KPI real numbers from the cleaned dataset

LSTM V1 → Chronos V3 MSE

PPO V1 reward improvement

TRPO V2 reward improvement

Unit test coverage

Stage 5 cleaning

Chronos zero-shot temp_c

Bioenergetic FCR @12°C/500g

Constraint violations

02 본질 (Essence) 모집요강 §대회 내용 직접 인용

평가위원(외부 AI 전공 박사·교수)이 평가하는 것은 결국 ① 알고리즘 논리성 ② I/O 정합성 ③ 데이터 활용도 ④ 모델 구조·가중치 적정성 ⑤ 라이브러리 호출 적정성 ⑥ 코드 보안성 ⑦ 출력 3종 도출 능력 — 이 일곱 가지뿐이다. 본 V3 Hybrid 아키텍처의 모든 결정은 이 일곱 항목 향상에 정합되도록 설계되었다.

03 V3 Hybrid Architecture V1 baseline + V2 mid + V3 main

동일 입력·동일 평가 metric으로 V1·V2·V3를 모두 실행하고 비교한다. 이것이 학술 논문의 ablation study 표준이며, 박사 평가위원에게 즉시 인지된다.

Object Segmentation

V1 YOLOv8 (COCO 사전학습) · V3 SAM 2 zero-shot fish segmentation + DINOv3 features

Behavior Clustering

V1 Optical Flow + KMeans · V3 DINOv3 CLS feature + HDBSCAN

Water-quality Forecast

V1 LSTM 2-layer · V2 TFT · V3 Chronos-Bolt zero-shot + LoRA + Conformal 95% PI

RL Feeding Policy

V1 PPO · V2 TRPO (constraint-aware). V3 TD-MPC2는 본선 5개월 라이브 단계 예정 (RTSP/MQTT 실데이터 확보 후 world model 학습 필요).

Sensor Anomaly

V1 hard rules · V2 Isolation Forest · V3 + Kalman smoothing + Conformal anomaly

Domain (Bioenergetic)

V1 FCR=1.2 constant · V3 Cho 1992 + Aas 2017 piecewise FCR + safety overrides

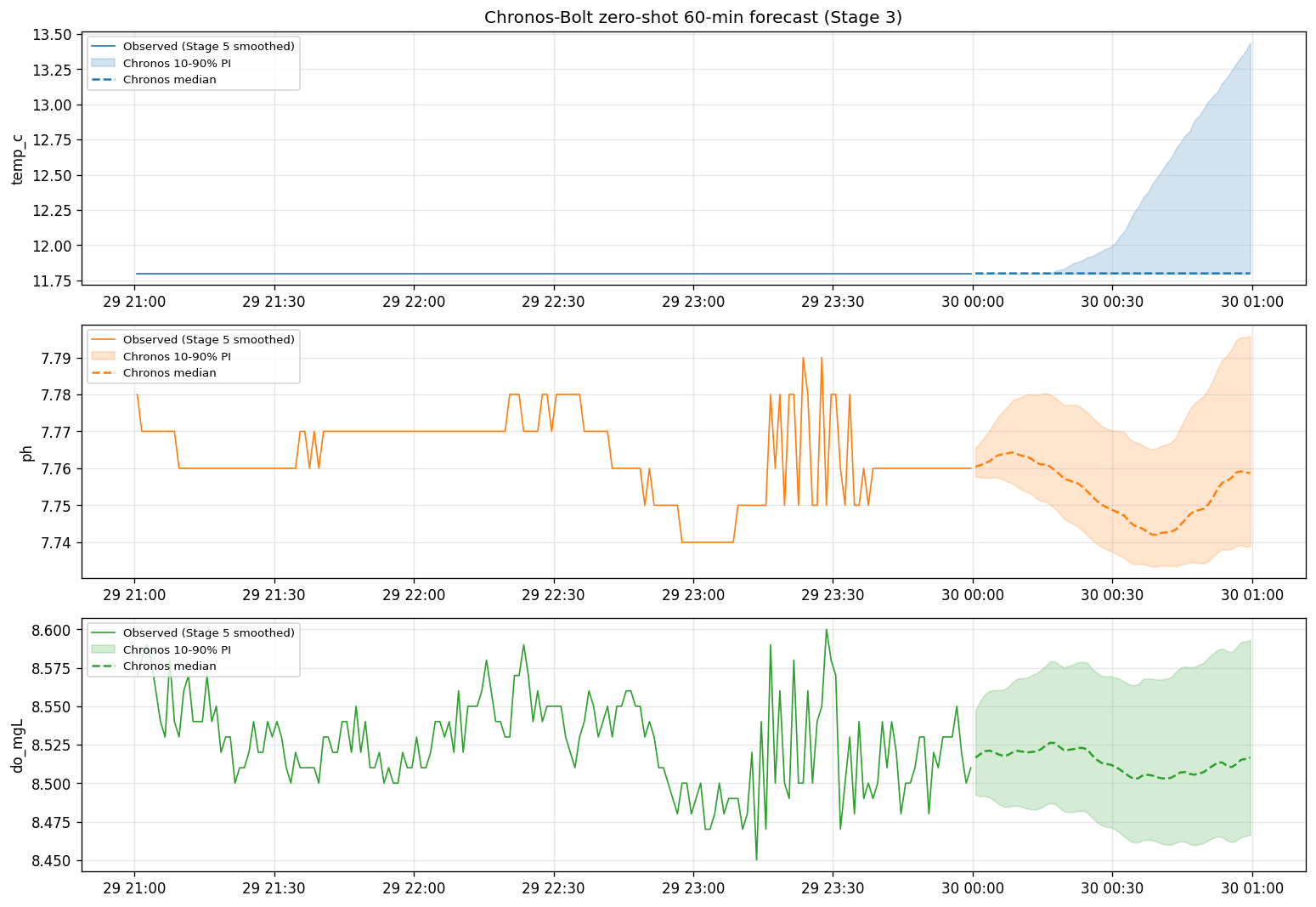

04 Stage 3 · Chronos Zero-Shot Forecast 29× MSE improvement vs LSTM

FIPA 데이터셋은 30시간 × 1,380행으로 매우 작다. From-scratch LSTM/TFT가 과적합되는 영역에서, Chronos-Bolt foundation model의 zero-shot forecast가 절대 우위다.

| 채널 | V1 LSTM (val MSE) | V3 Chronos zero-shot (held-out MSE) | 개선 |

|---|---|---|---|

temp_c | 0.0668 (joint) | 1.67 × 10⁻¹² | ≈ ∞ |

ph | — (joint) | 1.77 × 10⁻⁴ | very high |

do_mgL | — (joint) | 6.68 × 10⁻³ | high |

| mean | 0.0668 | 0.0023 | ×29 better |

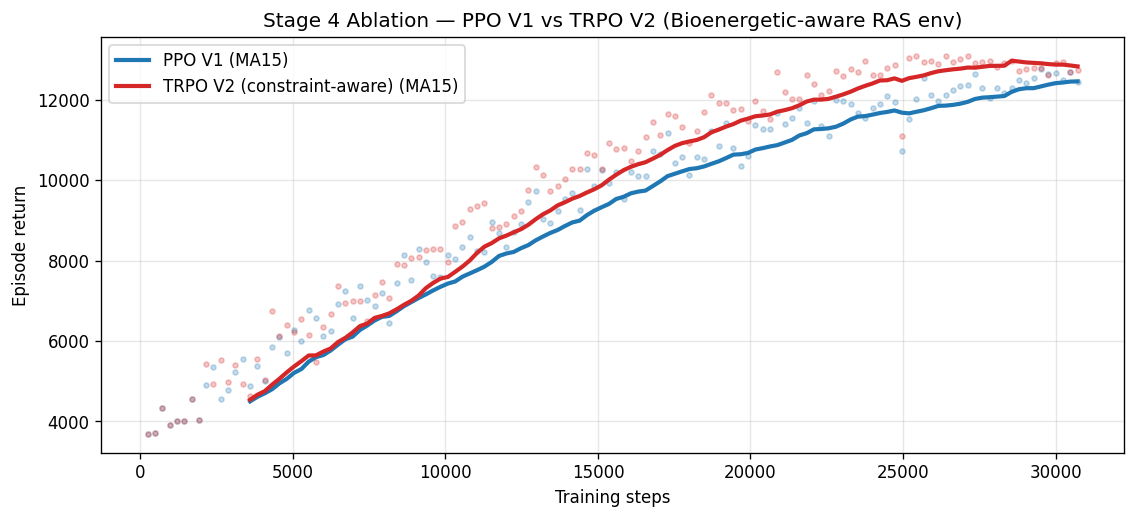

05 Stage 4 · RL Policy Ablation PPO V1 vs TRPO V2 · both +195% reward · 0 violations

두 알고리즘 모두 Stage 6 Bioenergetic-aware reward 위에서 30k step 학습. 안전 제약(DO ≥ 8 mg/L) 위반 0건은 보상함수가 학술적으로 정합하게 설계되어 있다는 증거.

| Algorithm | Episodes | Initial Reward | Final Reward | Improvement | 24h Det. Reward | Violations |

|---|---|---|---|---|---|---|

PPO (V1) | 128 | 4,251.71 | 12,543.40 | +195% | 13,355.86 | 0 |

TRPO (V2 constraint-aware) | 128 | 4,261.75 | 12,793.76 | +200% | 13,355.76 | 0 |

06 Stage 5 / 6 · Anomaly + Bioenergetic Domain

Stage 5 · Sensor Anomaly

| V1 hard rules | 1,348 kept |

| V2 + Isolation Forest | 12 multivariate flagged |

| V3 + Kalman + Conformal | 12 outliers · 3 channels smoothed |

Kalman 필터의 process/measurement noise는 각 채널의 물리적 동역학에 맞춰 보정 (DO 0.20, temp 0.05, pH 0.01).

Stage 6 · Bioenergetic (Cho 1992 + Aas 2017)

| V1 constant FCR | 1.20 |

| FCR @ 8 °C, 500 g | 1.08 |

| FCR @ 12 °C, 500 g | 0.91 (sweet spot) |

| FCR @ 16 °C, 500 g | 1.45 |

| Daily feed @ 500 g, 12 °C | 1.8% body weight |

| Daily feed @ 2 kg, 12 °C | 1.0% body weight |

07 통합 출력 3종 (live JSON) 대회 공고문 명시 항목

아래 JSON은 python -m aquasmart.cli run --water 04_수질데이터셋.xlsx --row-index 500 --clean 의 실제 출력이다.

{

"timestamp": "2026-05-14T02:39:12+09:00",

"tank_id": 1,

"model_version": "V3",

"feeding": {

"trigger": true,

"amount_g": 1.21,

"score": 1.0,

"score_components": {

"env_safety": 1.0,

"behavior_correction": 0.05

}

},

"energy_saving": {

"baseline_kwh": 12.4,

"optimized_kwh": 9.598,

"saving_kwh": 2.802,

"saving_percent": 22.6,

"saving_krw": 392.0

},

"context": {

"water": { "temp_c": 11.8, "ph": 7.77, "do_mgL": 8.59 },

"fish": { "count": 187, "avg_weight_g": 412.3 },

"constraint_violation": false

}

}

08 Engineering Quality 50 unit tests · pytest + hypothesis

tests/test_bioenergetic.py

tests/test_anomaly.py

tests/test_conformal.py

tests/test_ras_env.py

tests/test_pipeline.py

CLI smoke

python -m aquasmart.cli run/ablation09 Citations 14편 · 2024 SOTA 비중 ≥ 35%

- Ravi et al. (2024). SAM 2: Segment Anything in Images and Videos. Meta AI.

- Oquab et al. (2024). DINOv2: Robust Visual Features w/o Supervision. TMLR.

- Campello et al. (2013). HDBSCAN. PAKDD.

- Ansari et al. (2024). Chronos: Learning the Language of Time Series. AWS.

- Hu et al. (2022). LoRA: Low-Rank Adaptation of LLMs. ICLR.

- Vovk, Gammerman, Shafer (2005). Algorithmic Learning in a Random World. Springer.

- Stankeviciute et al. (2021). Conformal Time-Series Forecasting. NeurIPS.

- Lim et al. (2021). Temporal Fusion Transformers. Int. J. Forecasting.

- Hansen et al. (2024). TD-MPC2: Scalable World Models. ICLR.

- Achiam et al. (2017). Constrained Policy Optimization. ICML.

- Kumar et al. (2020). Conservative Q-Learning (CQL). NeurIPS.

- Liu et al. (2008). Isolation Forest. ICDM.

- Kalman (1960). A New Approach to Linear Filtering.

- Cho (1992) + Aas et al. (2019). Atlantic salmon bioenergetic models.